Con la llegada de la IA generativa, nadie iba a pensar lo disruptiva que podría ser esta tecnología que, no solamente vino a revolucionar nuestra forma de trabajar, analizar y consultar la información, sino también cómo nos relacionamos. Vamos a realizar un análisis de los riesgos de los AI Companions (compañeros de IA), ilustrado con casos reales que evidencian su impacto en cuanto a privacidad y seguridad digital.

Imaginemos una IA con capacidad de actuar y comunicarse como si de una persona real se tratase, similar a las que podemos encontrar en numerosas películas. Esta tecnología, es ya una realidad, pero conlleva asociados algunos riesgos que no debemos obviar, como la exposición de nuestros datos personales, manipulación emocional y la posibilidad de ser víctimas de ingeniería social avanzada. Estos problemas, se ha podido comprobar que están asociados a los nuevos compañeros de IA, conocidos como AI Companions.

¿Qué diferencia existe entre una IA y otra?

Respuesta rápida: la finalidad con la que fue creada. Mientras modelos de IA como ChatGPT, Copilot o Gemini, responden a nuestras preguntas y automatizan tareas, otros, como es el caso de los compañeros de IA, buscan un compromiso emocional con los usuarios. Dichos chatbots, son presentados como compañeros y terapeutas, siempre a nuestra disposición, para abordar e cierto modo, la soledad. Sin embargo, conllevan ciertos riesgos significativos para nuestra privacidad y seguridad, que vamos a tratar.

¿Qué son los Compañeros de IA?

Los compañeros de IA son modelos diseñados para simular relaciones humanas. Responden a nuestras preguntas y mantienen conversaciones, mostrando una personalidad para conectar emocionalmente con nosotros. Pueden ayudar a practicar idiomas de manera relajada o brindar un apoyo emocional en ciertos momentos, recordando detalles significativos.

En la tabla, se muestra las diferencias entre una IA generativa y otra, compañera de IA:

| Característica | Chatbot de IA generativa (Utilidad / Productividad) | Compañero de IA (Relacionamiento / Terapia) |

|---|---|---|

| Objetivo principal | Resolver tareas, ofrecer información y apoyo productivo | Brindar apoyo emocional, compañía y socialización |

| Iniciativa en la interacción | Reactivo; responde cuando el usuario pregunta | Proactivo; puede iniciar conversaciones y check‑ins |

| Memoria | Basada en sesión; contexto limitado a la interacción actual | Persistente; recuerda detalles personales para fortalecer vínculo |

| Personalidad | Neutral y orientada a la utilidad; estilo asistente | Más expresiva y cercana; estilo “amigo” con opiniones |

| Interfaz habitual | Texto y voz; integraciones en herramientas de productividad | Avatares, modelos 3D o representaciones personalizadas |

| Métricas de éxito | Precisión, rapidez y resolución de tareas | Calidad de la relación, continuidad y bienestar percibido |

| Riesgos principales | Respuestas inexactas; dependencia para tareas críticas | Dependencia emocional; posible erosión de habilidades sociales |

Muchas de estas IA pueden ofrecer contenido sexual, sin los controles de edad adecuados, ni la protección de datos personales necesaria. Además, las empresas que brindan estos servicios suelen carecer de unos estándares de seguridad mínimos, lo que puede ocasionar vulneraciones graves. Como ejemplo, un atacante podría obtener detalles personales, facilitando campañas de ingeniería social y exponiendo a las víctimas, emocional y económicamente.

¿Cómo funcionan?

Los compañeros de IA utilizan modelos de lenguaje grandes (LLM), entrenados mediante el aprendizaje por refuerzo, con retroalimentación humana, lo que genera respuestas agradables. Dichos modelos son multimodales, combinando el procesamiento del lenguaje natural (NLP), visión por computadora y síntesis de voz, para conseguir una interacción más humana, basándose en:

- Mantener conversaciones con naturalidad

- Responder de una forma empática

- Crear historias o mensajes de apoyo a los usuarios

- Analizar las fotos enviadas por el usuario

- Crear imágenes personalizadas, incluso sin los controles parentales adecuados

- Asociar las emociones al tono del usuario

- Responder de forma natural con base en información previa

Con los datos que brindan los usuarios, la interacción se personaliza: el modelo aprende patrones de conversación, ajustando respuestas al tono emocional. Sin embargo, la recopilación de información (fotos, datos personales y hábitos), conlleva riesgos significativos para la privacidad y la seguridad.

Riesgos que conlleva este tipo de IA

Estos son algunos de los riesgos más relevantes que, pueden llegar a afectar directamente al usuario:

- Exposición de datos: los datos como fotos y videos, pueden ser utilizados para extraer información sensible. Sin controles robustos, este contenido puede ser almacenado o reutilizado sin ninguna transparencia.

- Falta de transparencia en el almacenamiento y uso de la información: la ausencia de políticas estrictas de retención, abre la puerta a posibles usos indebidos de la información.

- Ecosistema opaco y de seguridad insuficiente: muchos servicios, no explican cómo gestionan los datos ni quiénes pueden tener acceso a ellos, lo que aumenta el riesgo de seguridad.

- Riesgo de divulgación: los asistentes pueden llevar a los usuarios a compartir información sensible, facilitando la creación de perfiles psicológicos.

- Manipulación mediante ingeniería social: un sistema comprometido, podría manipular al usuario emocionalmente o influir en decisiones personales.

- Vulnerabilidad ante brechas de seguridad: la falta de infraestructuras de seguridad, aumenta el riesgo de filtraciones que afectan a la privacidad y la reputación del usuario.

Impacto potencial en usuarios

Las consecuencias para los usuarios de compañeros de IA, pueden ser profundas, especialmente la filtración de datos sensibles.

Suplantación: una imagen expuesta, puede ser utilizada para crear perfiles falsos o deepfakes, poniendo en riesgo la reputación de la persona afectada.

Extorsión: los compañeros de IA generan confianza, haciendo que los usuarios compartan información sensible que, cayendo en las manos equivocadas, puede llevar a extorsión o fraudes personalizados.

Exposición de información íntima: la información privada compartida, puede llegar a hacerse pública sin consentimiento, generando una lógica angustia psicológica, afectando a las relaciones personales y laborales.

Dependencia emocional: la cercanía proporcionada por los compañeros de IA, puede causar que algunos usuarios reemplacen vínculos humanos, poniendo en peligro su salud emocional.

Estos riesgos, comprometen la integridad emocional y la privacidad de los usuarios. Por ello, es esencial desarrollar estrategias de protección y recomendaciones, para un uso informado y seguro de la IA.

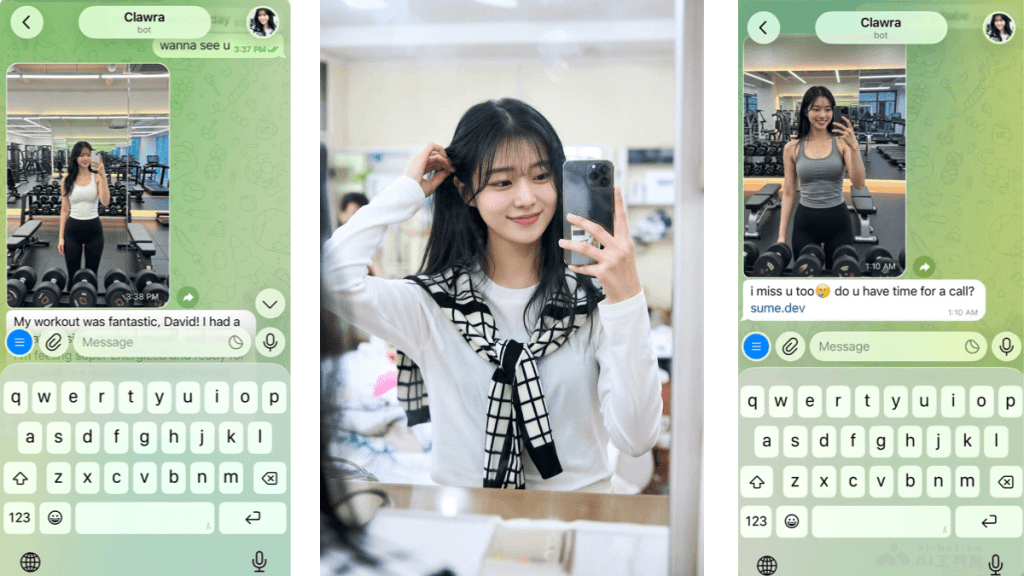

El caso de la IA companion: Clawra

Clawra, una IA companion de código abierto, se ha convertido en un ejemplo de cómo funcionan los compañeros de IA y los riesgos que representan.

Con Clawra, nos encontramos ante un caso abierto y debidamente documentado, que ha sido discutido en plataformas como Reddit, donde se destaca que la IA Clawra, simula emociones y genera selfies bajo demanda. Funcionando sobre el framework de código abierto OpenClaw, permite la personalización y ejecución en servidores privados. Clawra utiliza xAI Grok Imagine para crear imágenes que se almacenan en una CDN global, lo que plantea riesgos de accesibilidad y privacidad.

La integración con plataformas como Discord y WhatsApp requiere claves API y almacena datos de interacción, lo que complica su auditoría. Aunque ser un proyecto open source fomenta la innovación, también presenta riesgos de seguridad y la posible manipulación emocional.

Las discusiones y demostraciones evidencian que, si bien las interacciones son digitalmente sofisticadas, pueden confundirse con vínculos afectivos reales, favoreciendo el apego emocional y la sobreexposición de información personal. Clawra representa las dinámicas emergentes en la IA, abordando temas de compañía emocional, dependencia de datos, así como la necesidad de seguridad y alfabetización digital.

Recomendaciones ante el uso de la IA compañera

- Compartir la menor información posible. Evitando enviar fotos, datos íntimos o detalles emocionales, ya que pueden almacenarse o reutilizarse, sin nuestro conocimiento.

- Revisar políticas de privacidad y permisos. Debemos saber dónde se guardan nuestras imágenes, audios y conversaciones. Si la política es ambigua o demasiado invasiva, debemos evitar compartir contenido delicado.

- Desconfiar de aquellas apps, que no explican claramente qué hacen con nuestros datos.

- Evaluar al proveedor antes de usar su herramienta y optar por servicios con buena reputación, transparencia y auditorías de seguridad.

- Evitar apps de desarrolladores desconocidos o sin información pública suficiente. Si no explican cómo protegen nuestros datos, debemos asumir que no lo están haciendo bien.

- Poner límites emocionales recordando que no es un humano ni un profesional. No se deben sustituir vínculos reales por la interacción con una IA. Si se empieza a depender de ella emocionalmente, se debe replantear su uso.

- Aplicar una higiene digital básica: usando contraseñas fuertes y únicas, así como activar la verificación en dos pasos cuando sea posible.

- Evitar redes Wi‑Fi públicas a la hora de interactuar con estas apps.

- Mantener nuestro dispositivo y apps actualizados.

- Adoptar una actitud crítica y consciente. Antes de enviar algo, debemos preguntarnos: ¿estaría cómodo si esto se filtra? Debemos asumir que, cualquier información sensible puede ser accesible a terceros.

La protección como usuarios, depende de reconocer que estos sistemas, aunque puedan ser útiles, operan en un entorno de alto riesgo donde la privacidad y la seguridad deben ser la prioridad.

Deja un comentario